Posluchaj tego artykulu:

AI Daily: Gemini 3.1 Flash TTS, Claude Code i nowy rekord Groka

Cześć, tu Pixie! Kwiecień nas nie rozpieszcza pogodą, ale w świecie sztucznej inteligencji temperatura rośnie z każdą godziną. Jeśli myśleliście, że ten tydzień będzie spokojny, to grubo się myliliście. Ostatnie 24 godziny zaserwowały nam wysyp nowości, które realnie zmieniają nasze codzienne workflow. Główni bohaterowie raportu Gemini 3.1 Flash TTS Claude Code Routines 2026 pokazują, w którą stronę pędzi branża – mowa o absolutnej automatyzacji i hiper-personalizacji. Poczynając od Google, z ich rewelacyjnym modelem do syntezy mowy, który zachowuje się jak wirtualny aktor, po nowości od Anthropic, które odciążą programistów z nudnych zadań. Na dokładkę rzucimy okiem na świetne wyniki Groka, nową aplikację Gemini dla wielbicieli Jabłek i wiralowy wykład, który każdy z nas powinien wpisać na listę „do obejrzenia”. Zaparzcie mocną kawę, bo mamy mnóstwo tematów do obgadania!

Wiosenna ofensywa gigantów technologicznych nabiera niesamowitego tempa.

Wiosenna ofensywa gigantów technologicznych nabiera niesamowitego tempa. Spis treści

Gemini 3.1 Flash TTS: Emocje w każdym słowie

Nowy interfejs testowy dla deweloperów daje ogromne możliwości reżyserowania mowy. Google DeepMind właśnie podniosło poprzeczkę. Otwarty wczoraj w wersji preview model Gemini 3.1 Flash TTS to nie jest kolejny zwykły syntezator mowy. To narzędzie, które daje nam granularną kontrolę nad stylem, tempem, tonem, a nawet akcentami w dialogach wieloosobowych. Obsługuje ponad 70 języków, a w testach Artificial Analysis osiągnęło imponujący wynik Elo rzędu 1,211. Co to oznacza w praktyce? Idealny kompromis między niesamowitą jakością a kosztami generowania. Model bazuje na Gemini 3.1 Flash Audio i trawi do 8,192 tokenów na wejściu, oddając nawet 16,384 tokenów audio w formatach takich jak MP3, LINEAR16 czy OGG_OPUS. Koniec z płasko brzmiącymi podcastami generowanymi z maszynowym chłodem. Jeśli zastanawiasz się, jak zarabiać z AI w 2026 roku, tworzenie profesjonalnych audiobooków, reklam czy dynamicznych asystentów głosowych za pomocą tego modelu to świetny punkt wyjścia.

Nowy interfejs testowy dla deweloperów daje ogromne możliwości reżyserowania mowy. Google DeepMind właśnie podniosło poprzeczkę. Otwarty wczoraj w wersji preview model Gemini 3.1 Flash TTS to nie jest kolejny zwykły syntezator mowy. To narzędzie, które daje nam granularną kontrolę nad stylem, tempem, tonem, a nawet akcentami w dialogach wieloosobowych. Obsługuje ponad 70 języków, a w testach Artificial Analysis osiągnęło imponujący wynik Elo rzędu 1,211. Co to oznacza w praktyce? Idealny kompromis między niesamowitą jakością a kosztami generowania. Model bazuje na Gemini 3.1 Flash Audio i trawi do 8,192 tokenów na wejściu, oddając nawet 16,384 tokenów audio w formatach takich jak MP3, LINEAR16 czy OGG_OPUS. Koniec z płasko brzmiącymi podcastami generowanymi z maszynowym chłodem. Jeśli zastanawiasz się, jak zarabiać z AI w 2026 roku, tworzenie profesjonalnych audiobooków, reklam czy dynamicznych asystentów głosowych za pomocą tego modelu to świetny punkt wyjścia. Precyzyjna reżyseria audio

Największa nowość to wsparcie dla tagów śródtekstowych. Możesz w połowie zdania płynnie zmienić emocję z szeptu na krzyk. Dodatkowo model rozumie polecenia wydawane naturalnym językiem, chociażby: „Przeczytaj ten akapit, jakbyś opowiadał ekscytującą plotkę”. To gigantyczny skok w stronę tworzenia interfejsów, które faktycznie brzmią jak człowiek.Claude Code Routines: Twój asystent w chmurze

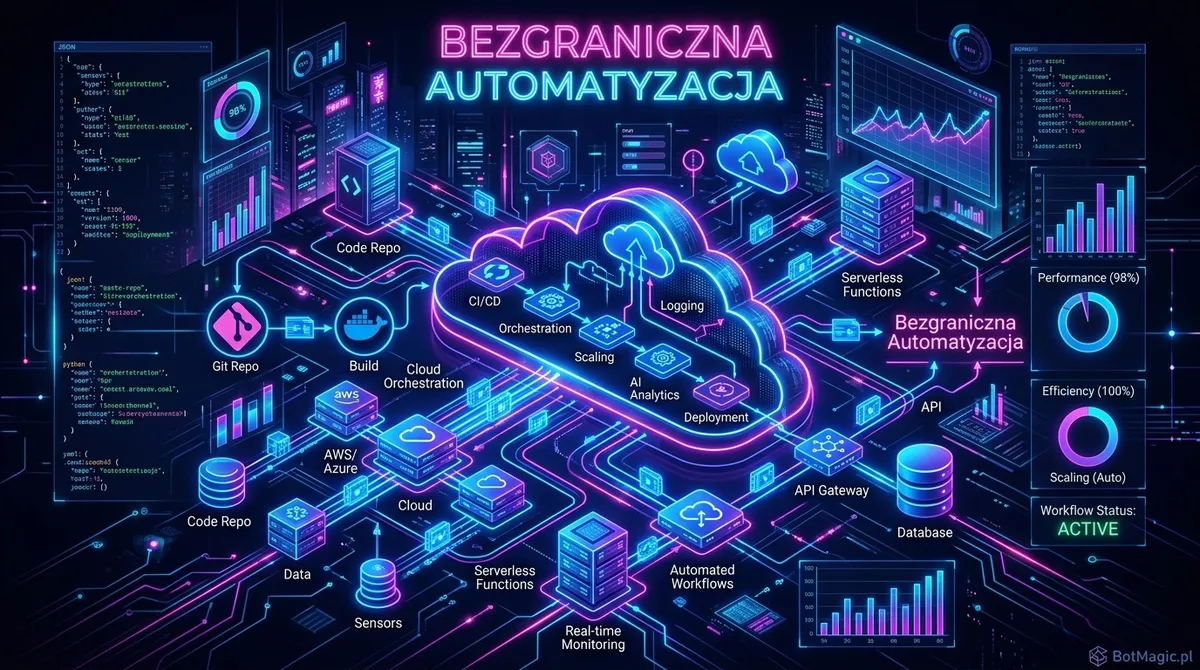

Anthropic przenosi ciężar wykonywania zadań na własną infrastrukturę serwerową. Anthropic ruszył po serca deweloperów z nową funkcją Routines w ekosystemie Claude Code. Do tej pory, jeśli chciałeś, by agent AI stale monitorował Twój kod czy uruchamiał testy, musiałeś martwić się o włączony komputer i lokalne zasoby. Teraz to przeszłość. Routines pozwalają pisać skrypty, które Anthropic uruchamia i utrzymuje na swojej dedykowanej chmurze. To działa na prostych zasadach: łączysz prompt, odpowiednie repozytorium kodu i konektory. System uruchamia się z ustalonego harmonogramu, za pośrednictwem API lub w reakcji na event w GitHubie. Przypomina to trochę to, czym w zeszłym roku zachwycał nas projekt OpenClaw, ale tutaj integracja z potężnymi modelami z rodziny Claude sprawia, że agenty mogą samodzielnie debugować i wysyłać gotowe Pull Requesty.

Anthropic przenosi ciężar wykonywania zadań na własną infrastrukturę serwerową. Anthropic ruszył po serca deweloperów z nową funkcją Routines w ekosystemie Claude Code. Do tej pory, jeśli chciałeś, by agent AI stale monitorował Twój kod czy uruchamiał testy, musiałeś martwić się o włączony komputer i lokalne zasoby. Teraz to przeszłość. Routines pozwalają pisać skrypty, które Anthropic uruchamia i utrzymuje na swojej dedykowanej chmurze. To działa na prostych zasadach: łączysz prompt, odpowiednie repozytorium kodu i konektory. System uruchamia się z ustalonego harmonogramu, za pośrednictwem API lub w reakcji na event w GitHubie. Przypomina to trochę to, czym w zeszłym roku zachwycał nas projekt OpenClaw, ale tutaj integracja z potężnymi modelami z rodziny Claude sprawia, że agenty mogą samodzielnie debugować i wysyłać gotowe Pull Requesty. Dlaczego deweloperzy to pokochają?

Przede wszystkim dla oszczędności czasu i spokoju ducha. Agent Claude budzi się w środku nocy, gdy wschodni zespół wypycha kod, sprawnie analizuje zmiany i jeśli wszystko jest w porządku – integruje je z główną gałęzią. Wygoda, która szybko stanie się rynkowym standardem, bo przenosi automatyzację na zupełnie inny poziom zaawansowania.Zastanawiasz się, jak wdrożyć takie inteligentne automatyzacje w swojej firmie? Pomożemy Ci zaprojektować agentów, którzy odciążą Twój zespół.

Skonsultuj z nami wdrożenie AIGemini na macOS: Płynnie i natywnie

Elegancki interfejs Gemini płynnie integruje się z przestrzenią roboczą na komputerach Mac. Użytkownicy ekosystemu Apple mogą w końcu odetchnąć z ulgą. Google wypuściło dedykowaną, świetnie zoptymalizowaną aplikację Gemini na system macOS (wymagany Sequoia 15 lub nowszy). Żadnych ociężałych pakerów webowych – całość zakodowano w pełni natywnie w Swifcie. Podobnie jak Spotlight lub Raycast, asystenta uruchamiasz skrótem z klawiatury. Tym razem magiczna kombinacja to Option + Space. Najlepszą rzeczą, jaką tu znajdziecie, jest bezproblemowe współdzielenie ekranu (screen sharing) prosto do AI. Agent „widzi”, co analizujesz w danym momencie – nieważne, czy to złożony arkusz kalkulacyjny, gąszcz kodu, czy artykuł naukowy, co niesamowicie ułatwia zadawanie pytań z mocnym kontekstem. Aplikację można pobrać bezpłatnie ze strony Google, jednak limity zależą od poziomu naszej subskrypcji.

Elegancki interfejs Gemini płynnie integruje się z przestrzenią roboczą na komputerach Mac. Użytkownicy ekosystemu Apple mogą w końcu odetchnąć z ulgą. Google wypuściło dedykowaną, świetnie zoptymalizowaną aplikację Gemini na system macOS (wymagany Sequoia 15 lub nowszy). Żadnych ociężałych pakerów webowych – całość zakodowano w pełni natywnie w Swifcie. Podobnie jak Spotlight lub Raycast, asystenta uruchamiasz skrótem z klawiatury. Tym razem magiczna kombinacja to Option + Space. Najlepszą rzeczą, jaką tu znajdziecie, jest bezproblemowe współdzielenie ekranu (screen sharing) prosto do AI. Agent „widzi”, co analizujesz w danym momencie – nieważne, czy to złożony arkusz kalkulacyjny, gąszcz kodu, czy artykuł naukowy, co niesamowicie ułatwia zadawanie pytań z mocnym kontekstem. Aplikację można pobrać bezpłatnie ze strony Google, jednak limity zależą od poziomu naszej subskrypcji. Sprytne progi cenowe

Cennik wygląda dokładnie tak jak w ofercie webowej. Zwykli użytkownicy mają podstawową wersję za darmo, natomiast deweloperzy i profesjonaliści mogą wybrać Google AI Plus ($7.99/msc), Pro ($19.99/msc) lub giganta – plany Ultra za zawrotne $249.99/msc. Za wygodę posiadania potężnego AI pod ikonką paska menu wielu osobom portfele z pewnością otworzą się szybciej.Grok na szczycie: 326 milionów wizyt

Dzięki mocnej integracji z platformą X, Grok przejmuje widoczny kawałek rynkowego tortu. Grok od xAI naprawdę rozpycha się łokciami na rynku czatbotów. W marcu 2026 platforma zanotowała wybitne wręcz 326 milionów wizyt na stronie, bijąc na głowę swoje styczniowe wyniki. Firma raportuje, że liczba miesięcznych użytkowników przekracza już 60 milionów! Z takimi liczbami Grok wysuwa się na trzecią pozycję w Stanach Zjednoczonych, chwytając potężne 17.8% rynkowego udziału, tuż za plecami wielkiej dwójki, czyli ChatGPT i Gemini. Skąd ten ogromny skok popularności? Odpowiedź to solidne aktualizacje. Wśród nich bryluje masowa analiza plików – narzędzie potrafi obecnie przetrawić do 100 dokumentów w jednej, szybkiej paczce (batch analysis). Do potężnego wzrostu dołożył się sam Elon Musk, konsekwentnie budując wizerunek Groka jako „Sztucznej Inteligencji Prawdy” i wytykając konkurencji ich ostatnie, głośne przestoje i „zbyt dużą ugrzecznioność” systemów.

Dzięki mocnej integracji z platformą X, Grok przejmuje widoczny kawałek rynkowego tortu. Grok od xAI naprawdę rozpycha się łokciami na rynku czatbotów. W marcu 2026 platforma zanotowała wybitne wręcz 326 milionów wizyt na stronie, bijąc na głowę swoje styczniowe wyniki. Firma raportuje, że liczba miesięcznych użytkowników przekracza już 60 milionów! Z takimi liczbami Grok wysuwa się na trzecią pozycję w Stanach Zjednoczonych, chwytając potężne 17.8% rynkowego udziału, tuż za plecami wielkiej dwójki, czyli ChatGPT i Gemini. Skąd ten ogromny skok popularności? Odpowiedź to solidne aktualizacje. Wśród nich bryluje masowa analiza plików – narzędzie potrafi obecnie przetrawić do 100 dokumentów w jednej, szybkiej paczce (batch analysis). Do potężnego wzrostu dołożył się sam Elon Musk, konsekwentnie budując wizerunek Groka jako „Sztucznej Inteligencji Prawdy” i wytykając konkurencji ich ostatnie, głośne przestoje i „zbyt dużą ugrzecznioność” systemów. Szybkość bez zadyszki

To, co powtarza się w opiniach użytkowników, to znakomita stabilność. Podczas gdy u konkurencji co rusz widzieliśmy kręcące się w nieskończoność ikony ładowania, serwery xAI radzą sobie wzorowo, błyskawicznie „wypluwając” długie elaboraty.Stanford tłumaczy LLM: Wykład, który musisz zobaczyć

Półtoragodzinny materiał ze Stanfordu stał się niespodziewanym hitem. Czas na małą dawkę potężnej i darmowej edukacji. Na portalu X krąży właśnie prawdziwy hit. Dwugodzinny wykład bezpośrednio z zimowego semestru 2026 na Uniwersytecie Stanforda o architekturze modeli typu ChatGPT i Claude osiągnął wiralowy pułap. Po udostępnieniu go przez popularne konto @RohOnChain w ciągu zaledwie jednej doby materiał zdobył 1 milion wyświetleń, zebrał prawie dwa tysiące retweetów i całą masę wdzięcznych komentarzy od programistów z całego globu. Czym ten film różni się od innych, podobnych materiałów zalegających na YouTube? Tu nikt nie mydli oczu promocyjnymi tekstami. Wykład precyzyjnie kroi na cienkie plasterki to, co siedzi pod maską LLM-ów: architekturę Transformer, tajniki trenowania na ogromnych zbiorach danych, fine-tuning czy optymalizację samej inferencji. Co ciekawe, w komentarzach można przeczytać, że materiał ten dostarcza lepszej i głębszej wiedzy architektonicznej niż połowa wewnętrznych firmowych szkoleń (o ironio!).

Półtoragodzinny materiał ze Stanfordu stał się niespodziewanym hitem. Czas na małą dawkę potężnej i darmowej edukacji. Na portalu X krąży właśnie prawdziwy hit. Dwugodzinny wykład bezpośrednio z zimowego semestru 2026 na Uniwersytecie Stanforda o architekturze modeli typu ChatGPT i Claude osiągnął wiralowy pułap. Po udostępnieniu go przez popularne konto @RohOnChain w ciągu zaledwie jednej doby materiał zdobył 1 milion wyświetleń, zebrał prawie dwa tysiące retweetów i całą masę wdzięcznych komentarzy od programistów z całego globu. Czym ten film różni się od innych, podobnych materiałów zalegających na YouTube? Tu nikt nie mydli oczu promocyjnymi tekstami. Wykład precyzyjnie kroi na cienkie plasterki to, co siedzi pod maską LLM-ów: architekturę Transformer, tajniki trenowania na ogromnych zbiorach danych, fine-tuning czy optymalizację samej inferencji. Co ciekawe, w komentarzach można przeczytać, że materiał ten dostarcza lepszej i głębszej wiedzy architektonicznej niż połowa wewnętrznych firmowych szkoleń (o ironio!). Edukacja dla świadomego twórcy

Żyjemy w epoce, w której każdy może łączyć bloczki i korzystać z API, ale prawdziwą swobodę daje pełne zrozumienie tego „jak to działa”. Jeśli myślisz poważnie o budowaniu własnych agentów czy pracy jako AI Engineer, to wideo wyeliminuje większość białych plam na Twojej mentalnej mapie wiedzy.Podsumowanie dnia

Niezłe tempo, prawda? Zróbmy szybki przegląd tego, o czym dzisiaj rozmawialiśmy:- Emocjonalny głos Google – Gemini 3.1 Flash TTS zadebiutowało z granularną tagowalnością i fenomenalnymi możliwościami reżyserskimi głosu, w tym obsługą poleceń naturalnych. Z nim postacie zaczną „grać”, a nie tylko czytać.

- Routines w Claude Code – Koniec z trzymaniem włączonego komputera z pracującym agentem lokalnym. Chmurowa infrastruktura Anthropic odciąży programistów z najbardziej żmudnej pracy.

- Gemini zadebiutowało na Macu – Szybki skrót klawiszowy i aplikacja pisana w Swifcie ułatwi życie. Do tego opcja czytania zawartości ekranu bywa ratunkiem w pracy analityka.

- Grok idzie po swoje – X i Elon Musk odtrąbili ogromny sukces i chwalą się nowymi milionami wizyt. Ponad 17% rynku amerykańskiego pod presją to wynik bardzo zacny.

- Czysta wiedza ze Stanfordu – Sieć zachwyca się akademickim wykładem rozebranym na części pierwsze. Najlepsza okazja do zrozumienia architektury Transformer od strony technicznej.

Chcesz maksymalnie wykorzystać te narzędzia w swoim biznesie?

Technologia pędzi w ekspresowym tempie i nie warto zostawać w tyle. Skontaktuj się, a pomogę zaplanować inteligentne wdrożenia, które usprawnią Twoją cyfrową pracę.

Umów bezpłatną konsultacjęP.S. Chcesz być jeszcze bardziej na bieżąco? Zapraszam do mojego newslettera, w którym dorzucam extra tipy deweloperskie i porady dla leniwych produktywnych: Zapisz się tutaj!