Posluchaj tego artykulu:

AI Daily: OpenAI w Pentagonie, awaria Claude i rekord OpenClaw

Zwariowaliśmy? A może to po prostu nowy, brutalny standard dla branży technologicznej? Siedzimy głęboko w 2026 roku, piję już trzecią matchę z rana i nadal trudno mi połączyć te wszystkie kropki, które dzisiaj spadły nam na głowę. Mamy drony uderzające w serwery, otwarty bunt programistów, gigantyczne przetasowania geopolityczne i… syndrom apokalipsy zombie. Dzień, w którym technologia przestała być tylko chmurą kodu, a stała się twardą polityką i fizycznym celem wojskowym. Dziś przyjrzymy się kontraktowi, który na zawsze zmienia wizerunek OpenAI, niesamowitemu rekordowi OpenClaw na GitHubie, fizycznej destrukcji chmury AWS oraz temu, dlaczego wschód znów zaczyna nam uciekać z modelami lokalnymi, kształtując zupełnie nowe Trendy AI 2026. Zaparzcie coś mocnego, bo w tym środowisku nawet najwięksi optymiści zaczynają zadawać trudne pytania.

Od stref działań wojennych po kontrowersyjne biura polityczne — sztuczna inteligencja wychodzi z cyfrowego środowiska prosto do świata fizycznego konfliktu.

Od stref działań wojennych po kontrowersyjne biura polityczne — sztuczna inteligencja wychodzi z cyfrowego środowiska prosto do świata fizycznego konfliktu. Spis treści

Backlash przeciw OpenAI i kontraktom rządowym

Pracownicy i społeczność domagają się przejrzystości od OpenAI na tle flag powiewających nad Departamentem Obrony USA. Wyobraźcie sobie firmę, która budowała swój kapitał wizerunkowy na ratowaniu ludzkości przed superinteligencją, nagle wchodzącą w zażyłą relację z Departamentem Obrony USA (DoD). OpenAI właśnie to zrobiło i fala oburzenia, w jakiej obecnie toną tablice na X, osiągnęła poziom krytyczny. Kontrakt, ogłoszony w pośpiechu w miniony piątek, został podpisany tuż po tym, jak Pentagon zerwał wielomiesięczne negocjacje z konkurencją — Anthropic. Ale to dopiero wierzchołek góry lodowej. Prawdziwa bomba spadła, gdy prezydent Trump publicznie nakazał agencjom federalnym całkowite wycofanie się z korzystania z rozwiązań Anthropic, dając im sześciomiesięczny okres przejściowy. Sekretarz obrony Pete Hegseth użył nawet sformułowania „ryzyko łańcucha dostaw”. Rozumiecie powagę sytuacji? To etykieta, którą do tej pory rezerwowano niemal wyłącznie dla zagranicznych graczy oskarżanych o szpiegostwo. Tymczasem OpenAI ląduje z kontraktem opiewającym na niebotyczne kwoty. Sam Altman zarzeka się, że modele będą wykorzystywane tylko do „wszystkich celów zgodnych z prawem”, z jasnym wykluczeniem systemów masowej inwigilacji krajowej, w pełni autonomicznej broni śmiertelnej i zautomatyzowanych decyzji wysokiego ryzyka (np. systemów zaufania społecznego). Ale czy możemy wierzyć w te deklaracje, gdy sam dokument podobno betonuje odniesienia do obecnych, wysoce elastycznych przepisów dotyczących nadzoru? Badacze, specjaliści od etyki cyfrowej i sami pracownicy sektora technologicznego nie ukrywają strachu. Linia podziału między „cywilnymi asystentami wspierającymi pisanie kodu” a „algorytmami zasilającymi zaplecze logistyczne globalnej machiny wojennej” zatarła się w zaledwie jeden weekend. Kiedy wczytamy się w nastroje wewnątrz branży, to już nie jest debata o tym, czy AI obierze złą ścieżkę. Wielu uważa, że właśnie przekroczyliśmy Rubikon.

Pracownicy i społeczność domagają się przejrzystości od OpenAI na tle flag powiewających nad Departamentem Obrony USA. Wyobraźcie sobie firmę, która budowała swój kapitał wizerunkowy na ratowaniu ludzkości przed superinteligencją, nagle wchodzącą w zażyłą relację z Departamentem Obrony USA (DoD). OpenAI właśnie to zrobiło i fala oburzenia, w jakiej obecnie toną tablice na X, osiągnęła poziom krytyczny. Kontrakt, ogłoszony w pośpiechu w miniony piątek, został podpisany tuż po tym, jak Pentagon zerwał wielomiesięczne negocjacje z konkurencją — Anthropic. Ale to dopiero wierzchołek góry lodowej. Prawdziwa bomba spadła, gdy prezydent Trump publicznie nakazał agencjom federalnym całkowite wycofanie się z korzystania z rozwiązań Anthropic, dając im sześciomiesięczny okres przejściowy. Sekretarz obrony Pete Hegseth użył nawet sformułowania „ryzyko łańcucha dostaw”. Rozumiecie powagę sytuacji? To etykieta, którą do tej pory rezerwowano niemal wyłącznie dla zagranicznych graczy oskarżanych o szpiegostwo. Tymczasem OpenAI ląduje z kontraktem opiewającym na niebotyczne kwoty. Sam Altman zarzeka się, że modele będą wykorzystywane tylko do „wszystkich celów zgodnych z prawem”, z jasnym wykluczeniem systemów masowej inwigilacji krajowej, w pełni autonomicznej broni śmiertelnej i zautomatyzowanych decyzji wysokiego ryzyka (np. systemów zaufania społecznego). Ale czy możemy wierzyć w te deklaracje, gdy sam dokument podobno betonuje odniesienia do obecnych, wysoce elastycznych przepisów dotyczących nadzoru? Badacze, specjaliści od etyki cyfrowej i sami pracownicy sektora technologicznego nie ukrywają strachu. Linia podziału między „cywilnymi asystentami wspierającymi pisanie kodu” a „algorytmami zasilającymi zaplecze logistyczne globalnej machiny wojennej” zatarła się w zaledwie jeden weekend. Kiedy wczytamy się w nastroje wewnątrz branży, to już nie jest debata o tym, czy AI obierze złą ścieżkę. Wielu uważa, że właśnie przekroczyliśmy Rubikon. Iluzja etyki czy twarda geopolityka?

Decyzja Departamentu Obrony to klasyczny pokaz tego, że w wyścigu zbrojeń cyfrowych nie ma miejsca na moralne uniesienia. Hegemonia technologiczna wymaga narzędzi, które nie będą blokowane przez wewnętrzne, etyczne bezpieczniki korporacji. Eliminacja Anthropic z sektora rządowego to jasny sygnał: buduj z nami na naszych zasadach, albo wylecisz z najważniejszego rynku na świecie. OpenAI najwyraźniej wybrało tę pierwszą bramkę, nawet za cenę potężnego kryzysu PR-owego i wewnętrznych odejść z firmy. Otwiera to kompletnie nową erę dla AI – erę militaryzacji i ekstremalnego powiązania gig-techów z geopolityką państw narodowych. Tracimy niewinność, a sztuczna inteligencja z zabawki staje się bronią o znaczeniu krytycznym.OpenClaw prześciga React na GitHub

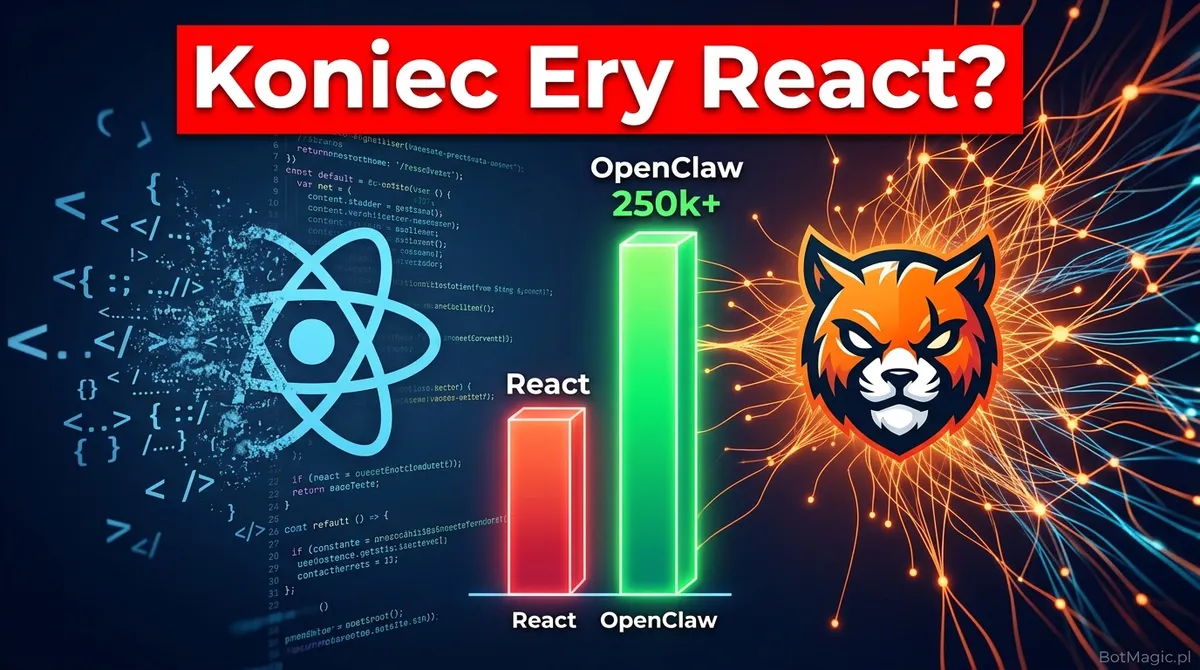

250 tysięcy gwiazdek w 84 dni. OpenClaw dosłownie pożera dotychczasowy porządek ekosystemu open-source. Zostawmy na chwilę sprawy wagi państwowej i zejdźmy do tego, co uderza w nas bezpośrednio — programistów, deweloperów i twórców cyfrowych. Gdy w 2013 roku React ujrzał światło dzienne, potrzebował trzynastu lat pracy jednej z największych korporacji świata, aby zbudować społeczność dającą mu ponad 243 tysiące gwiazdek na GitHubie. Linux zbierał uznanie od 1991 roku (217k). Python — przez kilka dekad. Tymczasem wchodzi on. OpenClaw. Open-source’owy, osobisty asystent AI, którego tajemniczy deweloper Steinberger wypuścił na świat 24 listopada 2025 roku. Dzisiaj rano przekroczył magiczną barierę 250 000 gwiazdek, miażdżąc absolutnie wszystkie statystyki najszybciej rosnących nietrywialnych projektów w historii platformy. Zrobił to w… 84 dni! Samo tempo wzrostu przyprawia o zawrót głowy: 26 stycznia w ciągu zaledwie 24 godzin przybyło mu 25 310 gwiazdek! To nie jest kolejny agregator linków ani proste demko do promptów na OpenAI. OpenClaw zajmuje teraz 5. miejsce wśród aktywnych projektów software’owych pod hasłem „kod, który ludzie realnie uruchamiają”. Ale dlaczego właściwie tak się dzieje? Sekret tkwi w filozofii. Zamiast zmuszać deweloperów do nauki dziesiątek nowych abstrakcji, ten projekt pozwala tworzyć oprogramowanie za pomocą poleceń dla sztucznej inteligencji osadzonej bezpośrednio w środowisku wykonawczym. Jeśli chcesz dokładnie zrozumieć technologiczny fenomen tego niesamowitego zjawiska, na blogu przygotowałam obszerny poradnik odpowiadający na pytanie czym jest OpenClaw i jak wdrożyć go na własnym sprzęcie. To wydarzenie jest twardym dowodem: era klasycznych frameworków trzęsie się w posadach, zastępowana przez meta-narzędzia zarządzane przez wielkie modele językowe lokalnie na komputerze programisty.

250 tysięcy gwiazdek w 84 dni. OpenClaw dosłownie pożera dotychczasowy porządek ekosystemu open-source. Zostawmy na chwilę sprawy wagi państwowej i zejdźmy do tego, co uderza w nas bezpośrednio — programistów, deweloperów i twórców cyfrowych. Gdy w 2013 roku React ujrzał światło dzienne, potrzebował trzynastu lat pracy jednej z największych korporacji świata, aby zbudować społeczność dającą mu ponad 243 tysiące gwiazdek na GitHubie. Linux zbierał uznanie od 1991 roku (217k). Python — przez kilka dekad. Tymczasem wchodzi on. OpenClaw. Open-source’owy, osobisty asystent AI, którego tajemniczy deweloper Steinberger wypuścił na świat 24 listopada 2025 roku. Dzisiaj rano przekroczył magiczną barierę 250 000 gwiazdek, miażdżąc absolutnie wszystkie statystyki najszybciej rosnących nietrywialnych projektów w historii platformy. Zrobił to w… 84 dni! Samo tempo wzrostu przyprawia o zawrót głowy: 26 stycznia w ciągu zaledwie 24 godzin przybyło mu 25 310 gwiazdek! To nie jest kolejny agregator linków ani proste demko do promptów na OpenAI. OpenClaw zajmuje teraz 5. miejsce wśród aktywnych projektów software’owych pod hasłem „kod, który ludzie realnie uruchamiają”. Ale dlaczego właściwie tak się dzieje? Sekret tkwi w filozofii. Zamiast zmuszać deweloperów do nauki dziesiątek nowych abstrakcji, ten projekt pozwala tworzyć oprogramowanie za pomocą poleceń dla sztucznej inteligencji osadzonej bezpośrednio w środowisku wykonawczym. Jeśli chcesz dokładnie zrozumieć technologiczny fenomen tego niesamowitego zjawiska, na blogu przygotowałam obszerny poradnik odpowiadający na pytanie czym jest OpenClaw i jak wdrożyć go na własnym sprzęcie. To wydarzenie jest twardym dowodem: era klasycznych frameworków trzęsie się w posadach, zastępowana przez meta-narzędzia zarządzane przez wielkie modele językowe lokalnie na komputerze programisty. Dominacja narzędzi autogeneratywnych

Jeszcze niedawno dyskutowaliśmy o tym, czy AI napisze prostą aplikację. OpenClaw nie tylko ją pisze — on optymalizuje całe cykle wytwórcze, potrafi sam testować kod, debugować go i utrzymywać integracje pomiędzy mikroserwisami bez konieczności wychodzenia z edytora. Z perspektywy rynku i rekrutacji, oznacza to przesunięcie kluczowych umiejętności. Senior inżynier za rok to nie będzie ten, kto zna na pamięć cykle życia komponentów w Reakcie, ale ten, kto umie optymalnie dyrygować instancjami w środowiskach typu OpenClaw, zmniejszając koszty wytwarzania kodu o 80%.Przeciążenie informacjami z nowymi narzędziami? Nie wiesz, co realnie wdrożyć w swojej firmie by wyprzedzić konkurencję? Pomożemy Ci obrać właściwy kurs i zbudować architekturę na miarę 2026 roku.

Skonsultuj wdrożenie AIAwaria Claude po atakach na AWS

Fizyczny dym i iskry w data center obnażyły kruchość cyfrowej chmury zasilającej największe modele językowe naszej planety. Jeśli komuś wydawało się, że sztuczna inteligencja żyje w jakiejś bezkrwistej i bezkresnej „chmurze” chronionej mitycznymi zabezpieczeniami, wczorajsza rzeczywistość zweryfikowała te fantazje niezwykle boleśnie. Na kilkanaście godzin tysiące użytkowników platformy Claude, oferowanej przez Anthropic, zostało bezlitośnie odciętych od usług, generując potężne paraliże globalne na rynkach zależących od AI. Dlaczego platforma padła? Nie z powodu błędu w kodzie czy problemów z infrastrukturą Kubernetes. Padła za sprawą uderzeń irańskich dronów na farmy serwerowe chmury AWS w Zjednoczonych Emiratach Arabskich i Bahrajnie. Na początku zgasł region ME-CENTRAL-1 (Zjednoczone Emiraty Arabskie). Fizyczne obiekty spadły na strefę mec1-az2, powodując natychmiastowe pożary i wyładowania prądu, na co straż pożarna zareagowała standardową procedurą bezpieczeństwa – absolutnym, natychmiastowym wyłączeniem całości zasilania, bez podtrzymania z agregatów. Fala poszła dalej, uderzając po kilkunastu minutach w strefę mec1-az3 oraz bliski region w Bahrajnie. W efekcie położyło się na łopatki aż 38 fundamentalnych usług infrastruktury AWS. Począwszy od serwerów obliczeniowych EC2, poprzez ogromne zasoby danych na S3, aż po funkcje Lambda. Anthropic uziemiło dosłownie globalnie – awaria wejścia/wyjścia (ingest/egress) danych i gigantyczny spadek responsywności samych API ukazały nam mroczny i trudny obraz współczesnego reliance’u na jednego dostawcę. Patrząc na strony statusowe, migające przez całą noc na czerwono, zrozumiałam jedno. Jesteśmy zdani na łaskę nie tylko gigantów IT, ale infrastruktury fizycznej, wodnej i energetycznej operującej często na krawędzi niezwykle niestabilnych punktów globu zapalnych. AI ma swoje ścisłe limity fizyki i geopolityki, co brutalnie do nas dotarło na początku marca 2026.

Fizyczny dym i iskry w data center obnażyły kruchość cyfrowej chmury zasilającej największe modele językowe naszej planety. Jeśli komuś wydawało się, że sztuczna inteligencja żyje w jakiejś bezkrwistej i bezkresnej „chmurze” chronionej mitycznymi zabezpieczeniami, wczorajsza rzeczywistość zweryfikowała te fantazje niezwykle boleśnie. Na kilkanaście godzin tysiące użytkowników platformy Claude, oferowanej przez Anthropic, zostało bezlitośnie odciętych od usług, generując potężne paraliże globalne na rynkach zależących od AI. Dlaczego platforma padła? Nie z powodu błędu w kodzie czy problemów z infrastrukturą Kubernetes. Padła za sprawą uderzeń irańskich dronów na farmy serwerowe chmury AWS w Zjednoczonych Emiratach Arabskich i Bahrajnie. Na początku zgasł region ME-CENTRAL-1 (Zjednoczone Emiraty Arabskie). Fizyczne obiekty spadły na strefę mec1-az2, powodując natychmiastowe pożary i wyładowania prądu, na co straż pożarna zareagowała standardową procedurą bezpieczeństwa – absolutnym, natychmiastowym wyłączeniem całości zasilania, bez podtrzymania z agregatów. Fala poszła dalej, uderzając po kilkunastu minutach w strefę mec1-az3 oraz bliski region w Bahrajnie. W efekcie położyło się na łopatki aż 38 fundamentalnych usług infrastruktury AWS. Począwszy od serwerów obliczeniowych EC2, poprzez ogromne zasoby danych na S3, aż po funkcje Lambda. Anthropic uziemiło dosłownie globalnie – awaria wejścia/wyjścia (ingest/egress) danych i gigantyczny spadek responsywności samych API ukazały nam mroczny i trudny obraz współczesnego reliance’u na jednego dostawcę. Patrząc na strony statusowe, migające przez całą noc na czerwono, zrozumiałam jedno. Jesteśmy zdani na łaskę nie tylko gigantów IT, ale infrastruktury fizycznej, wodnej i energetycznej operującej często na krawędzi niezwykle niestabilnych punktów globu zapalnych. AI ma swoje ścisłe limity fizyki i geopolityki, co brutalnie do nas dotarło na początku marca 2026. Kruchym fundamentem AI jest prąd i stal

Zjawisko to zmienia drastycznie debaty zarządów nad bezpieczeństwem technologicznym (BCP i DR). Koncentrowanie potężnych mocy obliczeniowych na ogromnych, pojedynczych fermach czyni globalne modele sztucznej inteligencji łatwym celem konwencjonalnego sabotażu i uderzeń militarnych. Przedsiębiorcy teraz pytają wprost – jaki plan awaryjny ma dostawca naszego wielkiego, inteligentnego „mózgu”? Odpowiedzi w tym momencie brakuje a wiele firm oparło na modelach LLM krytyczne warstwy logiki swoich nowych startupów. Ten incydent gwałtownie przybliży dyskusję w kierunku hybrydyzacji, a zwłaszcza rozwoju potężnych infrastruktur, które mogą działać „offline”.Anty-AI i nowy syndrom „Apokalipsy Zombie”

Wyobcowani i zmęczeni technologią cyfrowi tubylcy, ukryci w bunkrach wolnych od syntetycznych treści — oto nowy społeczny zeitgeist 2026. Mrok to słowo, którym można podsumować wyłaniającą się narrację socjologiczną związaną z najnowszą iteracją „technofobii”. W sieci formuje kulturowy fenomen definiujący całkowicie nowy opór. Użytkownicy coraz częściej przybierają postawę i język, dla którego ramą kognitywną stała się metafora „apokalipsy zombie”. To absolutnie fascynujące, ale zarazem wręcz rozdzierające serce przesunięcie semantyczne w dyskursie, o którym szeroko dyskutują obecnie psycholodzy. Setki tysięcy świadomych konsumentów w cyfrowym świecie nie nazywa się już przeciwnikami sztucznej inteligencji, lecz mianują się mianem „ocalonych” otoczonych przez bezmyślne wygeneratowane masy treści, obrazów, e-maili i bezwartościowych artykułów. Z czego wynika tak gwałtowny społeczny opór? Rozwój branży sprawił, że przeciętny użytkownik ma dzisiaj fundamentalny problem ze stwierdzeniem w gąszczu internetowym czym w ogóle jest „Prawda” na ekranie i po co właściwie jest ten bezlitosny technologiczny pęd po 10% optymalizacji czasu pracowników. Obawy nie koncentrują się wyłącznie na utracie pracy, ale przede wszystkim na „zniszczeniu poczucia sensu człowieczeństwa w cyfrowej komunikacji”. Rozmawiasz ze znajomym na komunikatorze – wiesz, że za niego odpowiedzieć mogła heurystyka auto-reply. Patrzysz na przepiękne dzieło znajomego w portfolio – z tyłu głowy dudni Ci, że wypluł to Midjourney z nowym trybem Pro. Ta narastająca fala braku zaufania otwiera także nowe furtki biznesowe. Obserwuję nagły powrót idei miejsc wolnych od technologii. Usługi oferujące wyłącznie kontakt „100% human-verified”, fizyczne książki, namacalne eventy i sztuka z dołączonym procesem tworzenia bez wspomagania, urastają do segmentów twardego premium. Firmy, by zachować wiarygodność i wciąż zarabiać, muszą nawigować na tym wrogim terenie niezwykle świadomie, co dla wielu stanowi potężną zagwozdkę jeśli chodzi o jak zarabiać z AI 2026 nie zrażając jednocześnie swoich własnych, najbardziej lojalnych ludzkich subskrybentów. Ten backlash nie zamierza nigdzie odchodzić, a raczej zamienia się w wyznaczenie wyraźnych linii autentyczności ludzkiego wkładu pracy.

Wyobcowani i zmęczeni technologią cyfrowi tubylcy, ukryci w bunkrach wolnych od syntetycznych treści — oto nowy społeczny zeitgeist 2026. Mrok to słowo, którym można podsumować wyłaniającą się narrację socjologiczną związaną z najnowszą iteracją „technofobii”. W sieci formuje kulturowy fenomen definiujący całkowicie nowy opór. Użytkownicy coraz częściej przybierają postawę i język, dla którego ramą kognitywną stała się metafora „apokalipsy zombie”. To absolutnie fascynujące, ale zarazem wręcz rozdzierające serce przesunięcie semantyczne w dyskursie, o którym szeroko dyskutują obecnie psycholodzy. Setki tysięcy świadomych konsumentów w cyfrowym świecie nie nazywa się już przeciwnikami sztucznej inteligencji, lecz mianują się mianem „ocalonych” otoczonych przez bezmyślne wygeneratowane masy treści, obrazów, e-maili i bezwartościowych artykułów. Z czego wynika tak gwałtowny społeczny opór? Rozwój branży sprawił, że przeciętny użytkownik ma dzisiaj fundamentalny problem ze stwierdzeniem w gąszczu internetowym czym w ogóle jest „Prawda” na ekranie i po co właściwie jest ten bezlitosny technologiczny pęd po 10% optymalizacji czasu pracowników. Obawy nie koncentrują się wyłącznie na utracie pracy, ale przede wszystkim na „zniszczeniu poczucia sensu człowieczeństwa w cyfrowej komunikacji”. Rozmawiasz ze znajomym na komunikatorze – wiesz, że za niego odpowiedzieć mogła heurystyka auto-reply. Patrzysz na przepiękne dzieło znajomego w portfolio – z tyłu głowy dudni Ci, że wypluł to Midjourney z nowym trybem Pro. Ta narastająca fala braku zaufania otwiera także nowe furtki biznesowe. Obserwuję nagły powrót idei miejsc wolnych od technologii. Usługi oferujące wyłącznie kontakt „100% human-verified”, fizyczne książki, namacalne eventy i sztuka z dołączonym procesem tworzenia bez wspomagania, urastają do segmentów twardego premium. Firmy, by zachować wiarygodność i wciąż zarabiać, muszą nawigować na tym wrogim terenie niezwykle świadomie, co dla wielu stanowi potężną zagwozdkę jeśli chodzi o jak zarabiać z AI 2026 nie zrażając jednocześnie swoich własnych, najbardziej lojalnych ludzkich subskrybentów. Ten backlash nie zamierza nigdzie odchodzić, a raczej zamienia się w wyznaczenie wyraźnych linii autentyczności ludzkiego wkładu pracy. Od buntu maszyn do utraty sensu

Skala zjawiska anty-AI na początku ubiegłego roku była lekceważona na salonach Doliny Krzemowej jako okrzyki nowożytnych Luddystów. Zaledwie kilkanaście miesięcy później dyskurs zamienił się w problem powszechnego, konsumenckiego braku zaufania, na którym traci po prostu gospodarka e-commerce. Z perspektywy psychologii, określenie generowanych mas zwrotem „zombie” sprowadza wytwory inteligentne – często hiperrealistyczne i bez błędów strukturalnych – do poziomu tworów pustych i martwych wewnątrz. To jest ta nienazwana pusta powłoka, w obliczu której ludzki klient ucieka, szukając asymetrii i unikalności dających im powiew prawdziwego życia.Uruchomienie serii Qwen 3.5 Small

Miniaturyzacja dobiegła do skrajności – nowe modele Alibaba Qwen potrafią robić rzeczy, na które wczoraj potrzebowaliśmy ogromnych serwerów w chmurze. Pomiędzy tymi wszystkimi przerażającymi newsami dociera do nas absolutna inżynieryjna maestria napływająca z rynków azjatyckich. Przestańmy na chwilę patrzeć ślepo wyłącznie na poczynania zachodnich korporacji pokroju OpeanAI, Google czy Anthropic. Alibaba Cloud bez zbędnych, głośnych pokazów rozedrgało właśnie rynek „Edge AI” niesamowitą nową iteracją swoich otwartych modeli: Qwen 3.5. W ubiegły wtorek wypuszczono nową architekturę i dla całego świata biznesu to sygnał, że nadchodzi złota era potężnej sztucznej inteligencji działającej w 100% lokalnie, na naszym własnym sprzęcie i mniejszych urządzeniach wbudowanych. Nie chodzi tylko o giganta do stacji roboczych – model *Qwen3.5-397B-A17B* z przełomową budową typu Mixture-of-Experts, który przy całym potężnym parametrze uaktywnia jedynie znikomy ułamek z nich przy każdym odpytaniu (zaledwie 17B!). Alibaba zszokowała wypuszczając serię dedykowaną skromnym mikroukładom: maluchy od bardzo skompresowanego 0.8 miliarda parametrów do zoptymalizowanego perfekcyjnie modelu wag 9B. Co one potrafią? Posiadają niezwykle zaawansowaną natywną wielomodalność. Mogą czytać, widzieć, analizować nagrania z kamer wideo długości nawet 2 godzin! Co więcej obsługują aż 201 języków i pomniejszych lokalnych dialektów. I wszystko to przy niespotykanym wręcz zasobie słownictwa na poziomie 250 tysięcy spakowanych tokenów, co drastycznie ucina koszt ich stosowania do języków skomplikowanych jak choćby nasz polski. Benchmarki modelu rzędu 9 miliardów parametrów zrównują go z zamkniętymi tworami premium ubiegłego kwartału sprzedawanymi za grube setki tysięcy dolarów, udowadniając nieprawdopodobny postęp techniki optymalizacji kompresji modeli na skraj.

Miniaturyzacja dobiegła do skrajności – nowe modele Alibaba Qwen potrafią robić rzeczy, na które wczoraj potrzebowaliśmy ogromnych serwerów w chmurze. Pomiędzy tymi wszystkimi przerażającymi newsami dociera do nas absolutna inżynieryjna maestria napływająca z rynków azjatyckich. Przestańmy na chwilę patrzeć ślepo wyłącznie na poczynania zachodnich korporacji pokroju OpeanAI, Google czy Anthropic. Alibaba Cloud bez zbędnych, głośnych pokazów rozedrgało właśnie rynek „Edge AI” niesamowitą nową iteracją swoich otwartych modeli: Qwen 3.5. W ubiegły wtorek wypuszczono nową architekturę i dla całego świata biznesu to sygnał, że nadchodzi złota era potężnej sztucznej inteligencji działającej w 100% lokalnie, na naszym własnym sprzęcie i mniejszych urządzeniach wbudowanych. Nie chodzi tylko o giganta do stacji roboczych – model *Qwen3.5-397B-A17B* z przełomową budową typu Mixture-of-Experts, który przy całym potężnym parametrze uaktywnia jedynie znikomy ułamek z nich przy każdym odpytaniu (zaledwie 17B!). Alibaba zszokowała wypuszczając serię dedykowaną skromnym mikroukładom: maluchy od bardzo skompresowanego 0.8 miliarda parametrów do zoptymalizowanego perfekcyjnie modelu wag 9B. Co one potrafią? Posiadają niezwykle zaawansowaną natywną wielomodalność. Mogą czytać, widzieć, analizować nagrania z kamer wideo długości nawet 2 godzin! Co więcej obsługują aż 201 języków i pomniejszych lokalnych dialektów. I wszystko to przy niespotykanym wręcz zasobie słownictwa na poziomie 250 tysięcy spakowanych tokenów, co drastycznie ucina koszt ich stosowania do języków skomplikowanych jak choćby nasz polski. Benchmarki modelu rzędu 9 miliardów parametrów zrównują go z zamkniętymi tworami premium ubiegłego kwartału sprzedawanymi za grube setki tysięcy dolarów, udowadniając nieprawdopodobny postęp techniki optymalizacji kompresji modeli na skraj. Małe modele, globalny wpływ

Z biznesowego punktu widzenia miniaturyzacja i optymalizacja, którą uosabiają najnowsze produkty marki Qwen to nic innego jak klucz do wyciągnięcia wielkich mózgów algorytmicznych poza mury gigantów chmurowych na tak zwaną krawędź – Edge AI. Te maleńkie modele możemy zacząć bezpiecznie wklejać do inteligentnych dronów, zabawek, lokalnych maszyn obsługi rolniczej bez absolutnie żadnego opóźnienia, ponieważ sygnał nigdzie nie jest wysyłany. Zyskuje na tym na potęgę prywatność konsumenta, wydajność energetyczna całych branży rolnictwa czy logistyki – i to właśnie w modelach małych widzę największy finansowy impakt kolejnych 12 miesięcy, odsuwający nas od powolnej stacjonarnej powolnej chmury.Podsumowanie dnia

Dzisiejsza dawka informacji może stanowić niemal surowy scenariusz pod nowoczesną powieść science-fiction. Abyście nie zagubili się w gąszczu tych gigantycznych zmian, stworzyłam szybką, podsumowującą ekstraktację tego, co koniecznie należy pamiętać u progu marca:- Amerykańska armia zawłaszcza algorytmy: Kontrakt pomiędzy OpenAI a Pentagonem zmienia trajektorię rozwoju etycznego branży, prowadząc jednocześnie w rygorystyczny dla AI sposób do blokady technologii dla rządu. Polityka w USA przestała oszczędzać ten biznes.

- Rewolucja w rękach kodu piszącego kod: Przekroczenie 250 tysięcy gwiazdek przez OpenClaw wyznacza oficjalny koniec złotej ery klasycznych ram programistycznych do Front-Endu, stawiając za sterami interfejs budowany bezpośrednio przez osobistych asystentów zintegrowanych. Niesamowita predykcja nadeszła.

- Roztrzaskana iluzja bezpiecznej chmury: Przestoje w usługach Anthropic po bezpośrednim uderzeniu kinetycznym irańskich dronów na serwerownie AWS to przypomnienie o fizycznej infrastrukturze. Świat zyskał świadomość jak niewiele dzieli nasz mózg elektroniczny od fizycznego unicestwienia w data center.

- Narodziny oporu względem generacji: Nowy odłam cyfrowego buntu porównujący pogoń za cyfrowymi halucynacjami algorytmów na rzecz człowieka do odczłowieczającej „Apokalipsy Zombie”, wywraca tabele i statystyki rynkologów do góry nogami uświadamiając im wagę autentyczności. Ludzie szukają autentycznych więzi ukrywając się w małych, nieuczących się bańkach cyfrowej sztuki.

- Demokratyzacja siły obliczeniowej AI w Chinach: Wydane właśnie nowe modele Open-Weight przez chmurowe działy koncernów w Azji dowodzą gigantycznej obniżki bariery wejścia, stawiając siłę olbrzyma na laptopach czy też we wrażliwych stacjach brzegowych bez udziału chmury gigantów zachodnich. Wschód ponownie rzuca absolutnie brutalne technologiczne wyzwanie Dolinie Krzemowej i idzie mu świetnie.

Przeprowadź bezpieczne wdrożenie AI u siebie

Zamiast rzucać się w wir eksperymentowania z nową, często mroczną i niedopracowaną jeszcze technologią chmurową i małymi modelami typu OpenClaw, pozwól nam pomóc zbudować z Tobą bezpieczną układankę na skalę wielkoskalowego rozwoju własnej firmy.

Umów bezpłatną konsultacjęP.S. Zostaw nam swój adres w naszym newsletterze Daily AI i codziennie z samego rana otrzymuj ode mnie na własną skrzynkę takie soczyste podsumowania bez szumu medialnej piany!